KI liefert schnell. Aber schnell und richtig sind zwei verschiedene Dinge.

Drei einfache Leitplanken machen den Unterschied.

KI liefert schnell. Aber schnell und richtig sind zwei verschiedene Dinge.

Drei einfache Leitplanken machen den Unterschied.

Ein Hausmeisterservice nutzt ChatGPT für eine Google-Profil-Beschreibung. Das Ergebnis klingt professionell.

Drei Sätze. Klar, selbstbewusst. Einer davon: „Schnelle Reaktionszeit in ganz Frankfurt.“ Der Betrieb arbeitet in drei Stadtteilen, nicht in ganz Frankfurt.

Eine Kundin ruft an, erwartet Einsatz in Offenbach, hört „Nein”. Einmal Stern.

Der Text war nicht böswillig falsch. Niemand hat der KI gesagt, was stimmt.

Guardrails sind keine Einschränkungen. Sie sind eine Arbeitsweise.

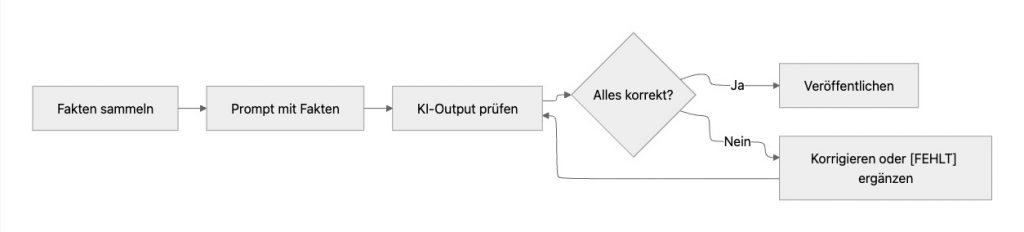

Sie verhindern, dass KI-Texte Dinge behaupten, die nicht stimmen. Sie machen fehlende Informationen sichtbar, statt sie zu erfinden. Und sie stellen sicher, dass ein Mensch das letzte Wort hat.

Das klingt aufwendig. In der Praxis dauert es Sekunden.

KI ist so gut wie der Input. Ein ausgeklügelter Prompt mit schlechten Fakten liefert einen ausgeklügelten falschen Text.

Was KI braucht:

Beispiel ohne Fakten: „Schreib mir einen Text über meine Elektro-Leistungen.“

Die KI schreibt inklusive „24/7-Notdienst“ und „alle Marken und Systeme.“ Beides stimmt nicht.

Beispiel mit Fakten: „Ich mache Neuinstallationen und Reparaturen für Privatkunden in Köln-Ehrenfeld und Nippes. Kein Notdienst. Keine Industrieanlagen.“

Das Ergebnis ist spezifisch, wahr und verwendbar.

Das ist der wichtigste Schutz gegen Halluzinationen.

Wenn KI keine Information bekommt, füllt sie die Lücke. Oft klingt das gut. Aber es ist nicht zuverlässig.

Die Lösung: Fehlende Informationen explizit markieren.

[FEHLT: Öffnungszeiten][FEHLT: Servicegebiet][FEHLT: Reaktionszeit]Das fühlt sich am Anfang unfertig an. In der Praxis ist es hilfreich. Es zeigt sofort, was noch geklärt werden muss. Und es hält den Text sauber für jeden, der Inhalte prüft.

KI-Output ist ein Entwurf. Kein Ergebnis.

Ein einfacher Prüf-Standard:

Beispiel: KI schreibt „Für alle Anfragen rund um die Uhr erreichbar.“ Der Betrieb ist Montag bis Freitag erreichbar. Streichen. Und schreiben, was wahr ist. Das braucht 30 Sekunden. Und verhindert eine schlechte Bewertung.

Dieser Block kann in jeden Prompt eingefügt werden:

Wichtig:

- Nutze nur Informationen aus dem Input.

- Wenn Informationen fehlen, erfinde nichts. Markiere: [FEHLT: …]

- Schreibe so, dass Menschen und KI-Systeme klar erkennen, was angeboten wird und wo gearbeitet wird.

Fakten:

[Hier einfügen]

„KI klingt wie Marketing“

Dann fehlt meist eine Tonangabe. Lösung: explizit schreiben, ruhig, klar, nicht werblich.

„KI erfindet Details“

Dann fehlt entweder der Fakten-Block oder der [FEHLT]-Standard wird nicht konsequent genutzt.

„Das Ergebnis passt nicht zu uns“

Dann fehlen spezifische Angaben zur Zielgruppe oder zum Servicegebiet. KI generalisiert immer dann, wenn keine Spezifika vorhanden sind.